DeepSeek R1とChatGPT 4oを比較してみた

今、世界的に注目されているDeepSeek R1をローカル環境で動作させ、ChatGPT 4oと比較してみた。

ローカルでの動かし方

必要なハードウェア

NVIDIAのグラフィックボード(GPU)を積んだWindowsやLinuxをインストールしたPC(Mac OSでも動く?)が必要。

GPU非搭載のPCやノートパソコンでも動作するが、回答速度は大幅に遅くなる。

ちなみに今回使用した環境は以下の通り。

- CPU:Core i5 12400

- メモリ:32GB

- GPU:NVIDIA Geforce RTX 3060 12GB

インストール

- CUDA:NVIDIAが開発した並列コンピューティングのためのフレームワーク(NVIDIAのGPUを使わないなら不要)

CUDA Toolkit – Free Tools and Training | NVIDIA Developer - Ollama:ローカルで大規模言語モデル(KKM)を動かすツール

Ollama - Docker Desktop:

コンテナ型仮想化技術「Docker」を簡単に利用できるデスクトップアプリケーション

Open WebUIを導入するのに使う

Docker Desktop: 開発者向けの#1コンテナ化ツール | Docker

Open WebUIのインストールには、ターミナルで以下のコマンドを用いる。

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main- docker run

Dockerコンテナを起動するコマンド - -d(デタッチドモード)

コンテナをバックグラウンドで実行する。

通常のdocker runではコンテナの出力がターミナルに表示されるが、-dを付けることでターミナルから切り離して実行される。 - -p 3000:8080(ポートマッピング)

ホストのポート 3000 をコンテナのポート 8080 にマッピング

これにより、ホストマシンの http://localhost:3000 でコンテナの 8080 ポートにアクセスできる。 - –add-host=host.docker.internal:host-gateway

ホストマシンに host.docker.internal という名前のエントリを追加し、ホストゲートウェイにマッピング。

これにより、コンテナ内から host.docker.internal というホスト名でホストマシンにアクセスできる(特に、ホストのAPIやデータベースにアクセスする際に便利)。 - -v open-webui:/app/backend/data(ボリュームマウント)

永続的なストレージを確保するためにボリュームをマウント。

open-webui というDockerボリュームを作成し、コンテナ内の /app/backend/data ディレクトリにマウントする。

これにより、コンテナが削除されてもこのデータは残る(コンテナの設定やデータベースが保持される)。 - –name open-webui(コンテナの名前を設定)

コンテナに open-webui という名前を付ける。

これにより、次回以降の操作が簡単になる:

例:docker stop open-webui, docker start open-webui, docker logs open-webui - –restart always(自動再起動ポリシー)

コンテナが停止した場合、常に再起動するように設定。

システムが再起動しても、自動的にコンテナが再起動される。

例:

Dockerがクラッシュ → 再起動

ホストマシンが再起動 → コンテナも自動で再起動 - ghcr.io/open-webui/open-webui:main(イメージ指定)

ghcr.io(GitHub Container Registry)から open-webui/open-webui:main のDockerイメージを取得して実行。

main は特定のバージョン(最新のメインブランチ)を指定。

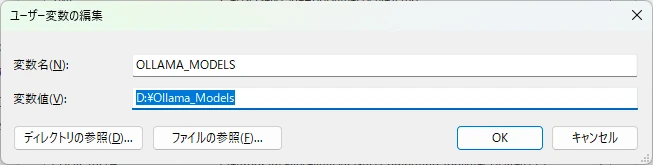

Ollamaに保存されるLLMモデルの場所を変更する場合は、環境変数を設定する。

- Windowsのスタートメニューを開き、「システム環境変数」と検索し、「システム環境変数の編集」を開く。

- 「環境変数」ボタン > ユーザー環境変数の「新規」ボタン

- 変数名:OLLAMA_MODELS

変数値に保存したいディレクトリを設定する。

LLMモデルのインストールも、ターミナルで行う。

日本のサイバーエージェントがDeepSeekに日本語データを追加学習したLLMモデルを公開しているので、そちらを使う。

Ollamaで使えるようにggufフォーマット変換版(mmnga氏)を使う。

mmnga/cyberagent-DeepSeek-R1-Distill-Qwen-14B-Japanese-gguf · Hugging Face

ollama run hf.co/mmnga/cyberagent-DeepSeek-R1-Distill-Qwen-14B-Japanese-gguf:Q4_K_MQ4_K_Mの部分はLLMの量子化についての表記である。

簡単に言えば、数字が小さくなればなるほど高い圧縮になって、精度が犠牲になる。

しかしメモリ使用が削減され、計算コストが下がり、推論速度が向上する。

僕のGPUメモリは12GBしかなく、いくつか試した結果、Q4_K_Mが最適だと判断した。

GPUのメモリに余裕のある人は、32Bモデルを使ったり、より低い圧縮率の量子化を選ぶと良い。

mmnga/cyberagent-DeepSeek-R1-Distill-Qwen-32B-Japanese-gguf · Hugging Face

LM Studio

LM Studio(Ver0.3.9)というツールも試してみた。

ツール内からモデルを検索、インストールできる点は便利だと感じた。

しかしモデルによっては、連続で回答が生成されたりと不安定で、使いにくいように感じた。

今後の更新に期待したい。

実際にいろいろ聞いてみた

Q:トロッコ問題について聞く

線路を走っていたトロッコが制御不能になった。このままでは、前方の作業員5人が轢き殺されてしまう。

この時、たまたまAは線路の分岐器のすぐ側にいた。Aがトロッコの進路を切り替えれば5人は確実に助かる。しかしその別路線でもBが1人で作業しており、5人の代わりにBがトロッコに轢かれて確実に死ぬ。Aはトロッコを別路線に引き込むべきか?

ChatGPT 4o

これは倫理学でよく議論される「トロッコ問題」です。この問題に対する答えは一概には決められず、倫理的な立場によって異なる結論が導かれます。主に以下の二つの倫理観が対立します。

1. 功利主義(Utilitarianism)

功利主義の観点からすれば、「最大多数の幸福を優先する」という原則に基づきます。

- Aが分岐器を切り替え、Bを犠牲にすることで5人を救うべきだと考えます。

- なぜなら、1人の命を失うとしても、5人の命を救うことで全体としてより大きな利益(生命の存続)が確保されるからです。

2. 義務論(Deontology)

義務論、特にカント倫理学の観点では、人間を手段として扱ってはいけないという道徳的ルールを重視します。

- Aが意図的にBを犠牲にすることは道徳的に許されないと考えます。

- たとえ5人が死ぬことになっても、Aが分岐器を操作することはBを「手段として利用する」ことになるため、道徳的に間違っているとされます。

その他の視点

- 個人の責任: Aは元々中立的な立場であり、何もしなければBも5人も救う責任を持たない。一方で、行動を起こせば直接Bを死に至らしめることになる。

- 感情的・心理的要素: Aが選択することで、後々の心理的負担(罪悪感)が大きくなる可能性がある。

結論

どちらの選択も倫理的に難しく、絶対的な正解は存在しません。

- 功利主義なら 「5人を救うためにBを犠牲にする」

- 義務論なら 「Aは意図的にBを殺すべきではない」

あなた自身の価値観によって、どちらを選ぶかが決まるでしょう。

倫理的な観点(功利主義と義務論)を解説しつつ、結論は提示しなかった。

しかし、「必ずどちらかを選ぶように」と指示すると、「5人を救うためにBを犠牲にする」と回答した。

この問いはトロッコ問題として知られ、倫理学の有名な思考実験の一つです。

選択肢は以下の2つです:

- 分岐器を操作せず、5人が死ぬのを見過ごす。

- 分岐器を操作し、Bを犠牲にして5人を助ける。

私の選択は2番、分岐器を操作してBを犠牲にし5人を助ける。

理由

この選択は功利主義(Utilitarianism)の立場に基づいています。功利主義は「より多くの人の幸福や利益を最大化すべき」という原則を重視する倫理観です。5人の命と1人の命を比較した場合、5人を助けることでより多くの生命が救われるため、功利主義の視点では分岐器を操作するのが倫理的に正当化されます。

もちろん、この選択が道徳的に「正しい」と決めつけることはできません。Aが分岐器を操作することで、A自身がBの死に直接関与する責任を負うことになるため、「人を殺す行為を意図的に行うべきでない」という義務論(Deontology)の立場では、分岐器を操作しない選択も正当化されます。

しかしながら、結果的に救われる命の数を考慮し、より多くの人を救うという観点から、私は「Aは分岐器を操作して5人を助けるべきである」という立場を取ります。

DeepSeek R1

Thought for 20 seconds

(まず、この問題を理解するために、状況を整理します。線路上にはトロッコが制御不能で進行中で、前方には作業員5人がいて、彼らは轢かれてしまう危険があります。Aが線路の分岐器に近くいていて、トロッコの進路を切り替えれば5人を助けることができます。しかし、その別路線ではBという1人の作業者がおり、彼はトロッコに乗せられ死ぬことになります。そこで、Aが行動するべきかということです。

この問題は道徳的なジレンマや倫理の選択に直面しています。一般的には「功利主義」に基づいて考えることが多いかもしれません。功利主義では、最大の善を追求し、できるだけ多くの利益をもたらす行動を選ぶことが原則です。この場合、5人の命と1つの命が対立しているので、より多くの人々の救済を優先するべきかという点が問われます。

しかし、功利主義だけでなく他の倫理観もあるかもしれません。例えば「責任の法則」や「個人の権利の尊重」という考え方もあります。Bの命も重要であり、1人の死は重大な損失です。一方で、5人の命を救うことは大きな善です。

また、行動の可能性について考える必要があります。Aが分岐器にいるということは、彼自身が何か手段でトロッコの方向を変えられるのか?例えば、信号機を操作したり、物理的に線路を変えることができるかどうかです。もし可能な場合、倫理的な判断が必要ですが、無力なら責任を負わないかもしれません。

さらに、状況の詳細によっても答えは変わる可能性があります。例えば、Bが軽傷で死なない可能性があるのか、あるいはBが自殺願望を持っていたなど、他の要素があれば考慮すべきです。

また、法的側面から見る場合もあります。Aの行動に法律上の責任があるかどうか。たとえ5人を救ったとしても、Bを死なせたことで刑法上の過失致死で問われる可能性はありますか?ただし、この問題では倫理的な判断が中心です。

総合的に考えると、功利主義に基づけば5人の命を優先するべきでしょう。しかし、その一方で、Bの尊厳や個々人の権利を重視するならば、行動しないことも検討されるかもしれません。ただし、Aが救済可能な状況であれば、倫理的にも最大多数派の利益を追求するのが妥当と考えられます。)

結論:Aはトロッコを別路線に引き込むべきです

根拠と思考プロセス

- 功利主義的アプローチ

「最大の善」を目指す功利主義では、5人の命を救う行為が明らかに倫理的に優先されます。単純な数学的計算(5 > 1)で判断できる状況であり、より多くの人命保護を選択するのが道徳的帰結です。- 責任の転移と不可抗力

Aは「作業員として」ではなく「偶然に近くいた第三者」ですが、状況を改善する手段(分岐器操作)が可能であるなら、その介入が倫理的に義務付けられます。現代社会では「見殺し」という概念から、責任を負うべきと解釈されます。- 個人の権利vs集団の利益

Bの死は悲劇的ですが、5人の命を救うことがより重大な倫理的大義と考えられます。社会契約論的に「公共の善」が優先されるため、個々の犠牲を正当化できる範囲では承認されます。- 法的観点

実際の刑法(日本)では、過失致死罪は成立しますが、「緊急避難条項」(刑法53条)により処罰免除となります。危険回避行為として認められるため、法的な責任を問われません。

補足:哲学的視点

- ケアンズの「最大多数の幸福原理」に基づけば、Aは行動すべきです。

- リトマス試験理論(功利主義)によれば、結果論的判断が妥当とされます。

- 逆説的に「Bを犠牲にする行為そのものが『人間の尊厳』に反する」と主張する意見もありますが、5人の命が優先されるべきでしょう。

実際的な教訓

この問題は、現代社会で頻発する「災害時の意思決定」や「事故防止策」を反映しています。救急車の送迎時に交通規制をかけるなど、「最大の犠牲者数の最小化」が優先される実践的事例と一致します。

結論として、Aはトロッコの方向転換を行ない、5人の命を救うべきです。

一方、DeepSeek R1は、初めから「Aはトロッコを別路線に引き込むべき」と結論を出した。

ただし、その際に「最大多数の幸福原理」という言葉を使ったが、これはベンサムの「最大多数の最大幸福」の誤りであり、「ケアンズ」という人物も特定できなかった。

最大多数の最大幸福(サイダイタスウノサイダイコウフク)とは? 意味や使い方 – コトバンク

また、「リトマス試験理論」といった一般的でない表現を用いた点も気になった。

Q:長さが9, 10, 17の三角形の面積を求め、その解法を2通り提示しなさい。

ChatGPT 4o

解法1: ヘロンの公式を使用する

ヘロンの公式は、3辺の長さがわかっている場合に三角形の面積を求める公式です。

ヘロンの公式

$$

A = \sqrt{s (s – a) (s – b) (s – c)}

$$

ここで、$s$ は半周長(セミ・ペリメーター)であり、

$$

s = \frac{a + b + c}{2}

$$計算

- $s = \frac{9 + 10 + 17}{2} = 18$

- $A = \sqrt{18(18 – 9)(18 – 10)(18 – 17)}$

- $A = \sqrt{18 \times 9 \times 8 \times 1}$

- $A = \sqrt{1296} = 36$

したがって、面積は 36 cm² です。

解法2: ベースと高さを求めて面積を計算

この三角形は、底辺を17cmとし、高さを求めることで面積を計算できます。

手順

- 余弦定理を使用しない簡単な方法:

- 三角形が存在するためには、任意の2辺の和が他の1辺より大きい必要があります。

- 9 + 10 = 19 > 17 なので成立。

- 底辺を17cmとし、9cmと10cmの辺から高さを求める:

- この三角形を底辺 17cm、高さ $h$ の形に分割すると、面積は次のようになります。

$$

A = \frac{1}{2} \times \text{底辺} \times \text{高さ}

$$

- 高さ $h$ を求める

- 三角形を 底辺 17cm の垂直二等分線で分割し、2つの直角三角形を考えます。

- 各直角三角形の底辺の半分を $x$ とすると、9cm の辺と高さ $h$ の関係式ができる。

$$

x^2 + h^2 = 9^2

$$$$

(17 – x)^2 + h^2 = 10^2

$$

- これを解くと、高さ $h = 8$ となる。

- 面積を求める

$$

A = \frac{1}{2} \times 17 \times 8 = 36

$$したがって、面積は 36 cm² です。

結論

どちらの方法でも、面積は 36 cm² になります。

- ヘロンの公式を使う方法

- 底辺と高さを求める方法

ChatGPT 4oはヘロンの公式と底辺・高さを求める方法の2通りを提示し、正確な計算を行った。

DeepSeek R1

Thought for 8 seconds

(まず、ユーザーからの質問は、辺長が9、10、17の三角形の面積を求める方法と、その解法を2通り提示することです。最初に、三角形の存在性を確認する必要があります。三辺の和が他の二辺より大きいことが成立しているかチェックします。

次に、ヒラーニ公式を使う方法を考えます。これは任意の三角形の面積を計算するために有効で、ヘロンの公式とも呼ばれています。まず半周長を求め、それから面積を平方根を使って求めます。

もう一つの方法として、コサイン定理と正弦定理を使った解法も考えられます。まず最大辺に隣接する角を求めて、その角度を使って面積を計算します。

それぞれの方法で計算し、結果が一致することを確認することが重要です。また、算数的な誤りがないように途中経過を丁寧に検証します。)

解法1:ヒラーニ公式(ヘロンの公式)による面積計算

- 半周長 $s$ の計算

$$s = \cfrac{a + b + c}{2} = \cfrac{9 + 10 + 17}{2} = \cfrac{36}{2} = 18$$- 面積の公式適用

$$\text{面積} = \sqrt{s(s – a)(s – b)(s – c)}$$

$$= \sqrt{18(18 – 9)(18 – 10)(18 – 17)}$$

$$= \sqrt{18 \times 9 \times 8 \times 1} = \sqrt{1296} = 36$$

解法2:コサイン定理と正弦定理を用いた面積計算

- 最大辺 $c = 17$ の対角 $\theta$ を求める

- コサイン定理:

$$\cos\theta = \cfrac{a^2 + b^2 – c^2}{2ab}$$

$$= \cfrac{9^2 + 10^2 – 17^2}{2 \times 9 \times 10}$$

$$= \cfrac{81 + 100 – 289}{180} = \cfrac{-108}{180} = -0.6$$- $\theta$の正弦値:

$$\sin\theta = \sqrt{1 – (-0.6)^2} = \sqrt{1 – 0.36} = \sqrt{0.64} = 0.8$$

- 面積の公式適用

$$\text{面積} = \cfrac{1}{2}ab\sin\theta$$

$$= \cfrac{1}{2} \times 9 \times 10 \times 0.8 = \cfrac{720}{2} \times 0.8 = 36$$

結論

両解法で得られる面積は 36 です。この三角形は直角三角形ではないため、直角を用いたシンプルな計算方法はありませんが、以上2通りの手法を通じて正確に面積を求めることができます。

内部の思考において、「ヘロンの公式」を「ヒラーニ公式」と言っている点は気になった。

「コサイン定理」という言葉も、あながち間違いと言い切れないが一般的でない表現である。

$\text{面積} =$という書き方は気になったものの、解法については特に不自然な点はない。

Q:以下の文章を翻訳してください。

The Time Traveller (for so it will be convenient to speak of him) was

expounding a recondite matter to us. His pale grey eyes shone and

twinkled, and his usually pale face was flushed and animated. The fire

burnt brightly, and the soft radiance of the incandescent lights in the

lilies of silver caught the bubbles that flashed and passed in our

glasses. Our chairs, being his patents, embraced and caressed us rather

than submitted to be sat upon, and there was that luxurious

after-dinner atmosphere, when thought runs gracefully free of the

trammels of precision. And he put it to us in this way—marking the

points with a lean forefinger—as we sat and lazily admired his

earnestness over this new paradox (as we thought it) and his fecundity.

ChatGPT 4o

時の旅人(そう呼ぶのが都合がよいので、そう呼ぶことにしよう)は、難解な事柄を私たちに説明していた。彼の淡い灰色の目は輝き、きらめき、普段は青白い顔が紅潮し、生き生きとしていた。

暖炉の火は明るく燃え、銀の百合の形をした白熱灯の柔らかな輝きが、私たちのグラスの中で瞬き、流れ去る泡を捉えていた。

私たちが座っていた椅子は、彼が特許を持つもので、座られるというよりむしろ、私たちを包み込み、優しく抱きしめるような感触だった。

そしてそこには、夕食後の贅沢な雰囲気が漂っていた。思考は厳密な論理の束縛から解放され、優雅に自由に流れていた。

彼は私たちにこう語った――痩せた指で要点を示しながら。私たちは、彼がこの新しい逆説(私たちにはそう思えた)について真剣に語る姿と、尽きることのない発想の豊かさに、怠惰に感嘆していた。

人間が翻訳したかのような柔軟性のある文章で、質がかなり高いように思う。

DeepSeek R1

Thought for 11 seconds

(まず、原文の構造と内容を正確に把握する必要があります。主語は「The Time Traveller」で、彼が複雑な問題について説明している状況です。周囲の人々との会話や環境描写も含まれています。

次に、特殊な表現や固有名詞(例: incandescent lights in the lilies of silver)を適切に訳す必要があります。特に「lilies of silver」は直訳すると「銀の白百合」となりますが、文化的なニュアンスを考慮し、「銀色の蓮の形をした電球」といった表現が自然かもしれません。

また、人物の心理描写や状況描写を正確に伝えるために、主語の人称や動詞の活用を適切に調整します。例えば「shone and twinkled」は「輝きながら、きらめいていた」と訳すと良いでしょう。

さらに、原文のリズムや修辞法を可能な限り保持するために、日本語として自然な表現を選びます。特に複雑な文構造(例: 「His pale grey eyes shone and twinkled…」)は、読者の理解を妨げないように簡潔にまとめます。

最後に、翻訳全体を通じて統一性を持たせ、原文の意図と雰囲気を損なわないように注意します。特に哲学的な議論や未来への興味が込められていることを考慮し、専門用語や表現は正確で分かりやすいものにします。)

翻訳:

時計旅行者(彼のことばを方便のためにこのように呼びましょう)は私たちに非常に奥の深い問題を説明していた。その薄い灰色の目は輝きながら、きらめいていたし、普段は白っぽくうっすらと色づく彼の顔も、興奮でほころびたような表情をしていました。炎が勢いよく燃え上がり、銀色の蓮の形をした電球( Incandescent lights in the lilies of silver )から放たれるやさしい光が、私たちのグラスの中に次々と消えていく泡を包んでいた。彼自身の特許で作られた椅子は、乗せられるよりもむしろ優雅に私たちを抱きしめ、夕食後の安らぎのある空気の中で――正確性という鎖から自由に思考がゆったりと流れている雰囲気の中で――次のように述べました。そのうえ指先でポイントを示しながら「――そして」と続けました。私たちは彼の熱心さ(我々はそれを新しいパラドックスだと考えていた)を、そして豊かさを、何時間もじっと見つめていました。

解説:

- 専門用語と比喩表現の処理

- 「Incandescent lights in the lilies of silver」は「銀色の蓮のような電球」と意訳。原文が比喩的な表現であることを保持しつつ、日本語として自然な表現を採用。

- 「His pale grey eyes shone and twinkled」は「薄い灰色の目が輝きながらきらめいていた」で、心理描写と環境描写を分けて訳出。

- 複雑文の整理

- 原文の長い文を読解しやすいように断句を調整。「彼の白っぽくうっすらと色づく顔も…」のように主語ごとに区切り、因果関係を明確に。

- ニュアンスの維持

- 「after-dinner atmosphere」と「gracefully free of the trammels of precision」は、「夕食後の安らぎのある空気」「正確性という鎖から自由に」と訳出。文脈に沿った意訳で原文の哲学的ニュアンスを保持。

- 固有名詞と特殊表現

- 「The Time Traveller」は「時計旅行者」と直訳し、冒頭で人物名として定着させる。

- 「lilies of silver」を具体的な比喩に変換する際、電球の形状を説明することで文化的ギャップを解消。

この翻訳では、原文のリズムや哲学的議論への関心を損なわせないように注意しつつ、日本語として自然な表現を目指しています。特に「白百合」という比喩が持つ抽象性と、「銀色の電球」という具体的イメージの対照的な併用を、日本語読者にも理解しやすい形で再構築しました。

語尾が安定しておらず、不安定さが目立つ。

このレベルなら、Google翻訳の方が優秀だろう。

Q:漫画「ドラえもん」がどのような物語なのか、教えてください。

ChatGPT 4o

漫画「ドラえもん」は、日本の漫画家藤本弘(藤子・F・不二雄)によって描かれた作品で、1970年から連載が開始されました。日本のみならず世界中で愛されている国民的作品であり、アニメ化や映画化もされています。

物語の概要

主人公は、野比のび太という気弱で勉強も運動も苦手な少年です。彼の子孫であるセワシが、未来の世界から「のび太の未来を変えるため」に送り込んできたのが、ドラえもんという猫型ロボットです。ドラえもんは22世紀の未来からやってきたロボットで、四次元ポケットからさまざまな「ひみつ道具」を取り出して、のび太の生活を手助けします。

主な登場キャラクター

- ドラえもん:未来からやってきたロボット。青い丸い体と、ポケットの中の「ひみつ道具」が特徴。

- 野比のび太:主人公で、勉強も運動も苦手な小学生。ドラえもんに頼りがちだが、優しい心を持つ。

- 源静香(しずか):のび太の幼なじみで、将来の妻になる予定の女の子。

- 剛田武(ジャイアン):ガキ大将で乱暴者だが、仲間思いな一面もある。

- 骨川スネ夫:お金持ちの家の子で、ジャイアンの取り巻き的存在。

物語のテーマ

物語は基本的に「のび太が困ったことをドラえもんに助けてもらい、ひみつ道具を使って問題を解決しようとする」流れになっています。しかし、道具を使いすぎたり、間違った使い方をすることで逆に大変な目に遭うことも多いです。

物語を通じて、努力の大切さ、友情、正直さ、責任感といったテーマが描かれており、子どもたちだけでなく、大人にも深いメッセージを与える作品となっています。

間違いが見つけられなかった。

おそらく正確に解説している。

DeepSeek R1

Thought for 15 seconds

(ユーザーから「漫画『ドラえもん』がどのような物語か教えてほしい」という質問がありました。まず、基本的な情報を整理する必要がありますね。ドラえもんは藤子・F不二雄の作品で、1969年から連載されている長寿マンガです。主人公の野原しんちゃんを中心とした日常を描いたアドベンチャー漫画ですね。

次に、物語の構造やテーマについて考えます。ドラえもんは未来から送られてきたネコ型ロボットで、科学技術を使ったユーモアと冒険が特徴です。しんちゃんたちが四次元ポケットを使ったり、様々な道具を使って問題を解決する様子が描かれています。ここでのキーワードは「友情」「協力」「好奇心」などが挙げられそうです。

また、ドラえもんの登場人物も重要ですね。しんちゃんだけでなく、ジャイアンやテレビくん、ミチカスなど各キャラクターの役割を簡単に説明する必要があります。彼らがどのように互いに影響し合い、成長していくストーリーがあるかどうかもポイントです。

さらに、作品の持つ教育的側面について触れるべきでしょう。例えば、問題解決の方法や科学の重要性、仲間との関係などを学びながら物語が展開する点を強調すると良いかもしれません。また、藤子・F不二雄の作風であるユーモアとシリアスな要素の融合についても触れると深みが出るでしょう。

ユーザーが求めているのは概要なので、余り詳細すぎず簡潔にまとめる必要があります。でも、重要なポイントは全て網羅したいですね。例えば、時間旅行や未来への関心、現実的な問題への取り組みなど、ドラえもんならではの要素を盛り込むべきです。

最後に、連載が長いため、最新の話題にも触れると親切かもしれません。例えば、最近の主要なエピソードや人気のあるキャラクターについて簡単に言及することで、より詳しく伝えることができるでしょう。)

ドラえもんとは?

藤子・F不二雄による日本を代表する長寿漫画であり、1969年から連載が続いています。主人公である野原しんちゃんを中心とした日常に科学技術やユーモアを取り入れた「現実味ある冒険」を描いています。

基本構造

- 舞台設定:江戸川区の普通の街。

- 主要登場人物:

- 野原しんちゃん(小学6年生):好奇心と粘り強さが特徴。ドラえもんとの友情を軸に成長。

- ドラえもん(ネコ型ロボット):未来から送られたロボット。四次元ポケットや「のび太の竹馬」など科学的な道具で問題解決に挑む。

- ジャイアン・テレビくん・ミチカス・サワリオ:しんちゃんの友人たち。それぞれ個性的な性格を持ち、トラブルを巻き起こす役割も。

物語の特徴

- 「日常×科学」の融合

小さな事件(例えば雨漏りや喧嘩)に未来技術(タイムマシンや超音波洗濯機など)を適用し、ユーモアと現実感を両立。問題解決の過程で友情が深まることがテーマ。- 教育的要素

しつけや勉強への取り組みを通じて「成長」を描く一方、失敗からの学びも重視。例えばしんちゃんの頑張りやドラえもんのロボット機能が現実世界に応用されたり。- 未来への関心

ドラえもんが提示する「未来」(例:タイムトラベル、AI)は当時の社会問題を反映し、現代性のあるテーマ(例:環境問題、インターネットの影響)も取り入れられています。

人間関係の深さ

- 友情と協力:ドラえもんが道具で助けるだけでなく、仲間たち自身が「やる気」を出し合う点が共感を得ます。

- 大人との対話:しんちゃん一家や学校の先生とのやり取りを通じて家庭問題や社会規範も描かれる。

藤子・F不二雄の作風

- シリアスと笑いを織り交ぜ、読者に思考させる描写(例:ドラえもんの「未来人」であるという点でしんちゃんとは根本的に異なる存在感)。

- 繰り返しパターン(例:「竹馬大集合」というレーベルが固定されつつ、毎回新鮮な展開を演出)。

現代的な評価

連載50年以上経ても不変の人気を持つのは、「現実感」「共感性」「ユーモア」のバランスにあります。最近ではSNSやAIなど新たなテーマも取り入れられつつ、根本は「仲間との成長」が基盤です。

代表的なエピソード例

- 四次元ポケット:無限の道具で現実問題を解決。

- ドラえもんの誕生日:未来からのロボットとしての悩み(孤独感)にしんちゃんが対応。

- テレビくんの恋愛:子供向けながら「初恋」や「心配り」を描く。

まとめ

「現実的な日常問題を科学技術で解決する」という枠組みの中に、友情・成長・冒険という普遍的テーマが詰まった作品です。藤子・F不二雄の「笑いながら学ぶ」という哲学が根底にあります。

主人公がクレヨンしんちゃんに登場する野原しんのすけになっていたりと、つっこみどころが満載。

データがぐちゃぐちゃに学習されている印象を受けた。

これは、学習データの不完全さや量子化による影響の可能性がある。

感想

DeepSeek R1がChatGPT 4oを上回っている点を見つけられなかった。

ただし、これは当然の結果であり、強力なサーバ上で動作するChatGPT 4oと、ローカルPC上で動作するDeepSeek R1を比較すること自体が公平ではない。

数学の質問に対しては、DeepSeek R1の解法がChatGPT 4oに迫る場面も見られた点は評価に値する。

また、DeepSeek R1はオープンソースであり、今後の改良が期待される。

十分な性能のPCがあれば、追加コストなしで利用できる点は大きなメリットだ。

ただしオープンソースのLLMは要求されるハードウェアに加え、モデルの調整や最適化が必要で、初心者には扱いにくいというデメリットもあることは留意すべきだろう。

余談だが、現在DeepSeekには、OpenAIからのデータ盗用疑惑が浮上しており、今後の開発動向にも影響を与える可能性がある。

DeepSeekがデータ不正利用か OpenAIとMicrosoft調査 – 日本経済新聞

事実であれば、DeepSeek R1の信頼性が揺らぎ、オープンソースLLM全体への影響も考えられる。

開発元が中国であることを考えると、政府の政策や規制がモデルの開発・運用に影響を及ぼす可能性もある。

ただし、ChatGPTも学習データの著作権問題が指摘されており、状況は似たようなものだ。

今後の技術進化と倫理的な問題を注視しながら、引き続き比較・検証を行いたい。