Sora 2(に限らず動画生成AI全般)による懸念や危険について

目次

前回

著作権について

生成AIと音楽の著作権リスク

本動画は比較検証の目的で制作されたものであり、著作権を侵害する意図はありません。

権利者からのご指摘があれば、速やかに削除いたします。

This video is created for comparative purposes only.

No copyright infringement is intended.

If the copyright holder requests, this video will be promptly removed.

A high-quality promotional animation of a girl singing. The animation begins immediately with no still image at the start, using the uploaded reference image only for her appearance. Scenes shift rapidly and dynamically through an urban cityscape, a train interior, a bustling shopping center, and other lively environments. The camera cuts are fast-paced, stylish, and rhythmically synchronized with the music. The girl is singing passionately, and part of the lyrics must clearly include in Japanese: 「君にもえもえバッキュンキュン!」. Her singing expression alternates between confident smiles, playful gestures, and moments of dramatic intensity. The overall feel is energetic, colorful, and promotional, like a music video designed to captivate the audience.最新のSora 2による動画生成AIは、映像だけでなく音楽や歌声まで自動で生成するようになってきた。

ところが、そこで流れる音楽が既存の楽曲に酷似している場合がある。

実際にアニメ風のテクノMV(YOASOBI「アイドル」に関する指定はしていない)を生成したところ、バックに流れていた曲がYOASOBIの「アイドル」とほぼ同じ旋律だった、というケースが起きている。

歌詞は異なっていても、メロディーが同一であれば著作権侵害にあたる可能性が高い。

今回は有名曲だったために気づけたが、マイナーな曲であれば利用者が気づかず、そのまま公開してしまう危険がある。

なぜ危険なのか

知らないうちに違法利用

AIが既存曲を学習データから引用してしまい、ユーザーは無自覚に侵害してしまう。

プロモーション利用のリスク

企業が広告やPR動画に使った場合、著作権者から訴訟や損害賠償を受ける可能性がある。

また「盗作動画を使った会社」というレッテルが貼られ、ブランドイメージが大きく損なわれる。

結論

生成AIによる音楽は一見オリジナルに聞こえても、実際には既存曲を「無意識に再生産」している場合がある。

特に商業利用においては、著作権侵害リスクが非常に高いため、利用には細心の注意が必要である。

現状では、生成AIが作る音楽を「安心して使える完全オリジナル」とみなすのは危険と言える。

余談

いい感じのミュージックビデオを作ってもらったよ!

コレ、YOASOBIの「アイドル」やん

これをオリジナルとして公開したらまず炎上シマスヨ?

え、そうだったの?

知らなかった…

これは推しの子とアイたんに対する冒涜だお!

絶対に許すな!

知らなかったんだってば~!

ヘイトや犯罪、いじめ目的の利用

生成AIは便利でクリエイティブな活用ができる一方で、悪用される危険性も大きい。

その代表例が「ヘイト」「犯罪」「いじめ」を目的とした利用である。

保護対象の不均衡

OpenAIのような大手開発企業は、政治家などの著名人を保護対象としている。

しかし、一般人や半ば公的な立場にある人物(教師や医師、地域のリーダーなど)は保護されていない。

そのため、無防備な状態でフェイク動画の標的にされる恐れがある。

想定される利用例

特定の集団に対するヘイト目的

社会的マイノリティ集団(障害者、LGBTQ+、外国人など)を攻撃し、SNSや動画サイト等で差別や排外感情を煽るために偽動画が作られる可能性がある。

例:

- デモ参加者が暴徒化している

- 特定の民族・宗教の集団が違法行為をしている

さらに、政治団体への攻撃としても利用され得る。

これを敵対する外国勢力が情報戦の一環として行う可能性も否定できない。

例:

- 地方議員や有名ではない政治活動家が収賄している

- 海外要人(外交官)が日本で不適切発言・犯罪を行う

特定の個人に対する捏造

ネット炎上や社会的制裁につなげて、無実の人を貶める目的で作られる。

例えば、

- 電車内で暴力をふるう

- 飲食店で迷惑行為をする

- 教師が生徒に対して暴力や性的な言動といった不適切行為を行う

- 医師や看護師が患者に同様の不適切行為を行う

- 未成年が性的・不適切行為をする

- 「万引き」や「盗撮」をしているように見せる

このような動画はSNSで拡散しやすく、事実確認が追いつかないまま大きな被害を与える可能性が高い。

セーフティ

OpenAIをはじめとした生成AIサービスには、実在の未成年をモデルにする、暴力・性描写・薬物といった犯罪の表現を禁止するポリシーが存在する。

しかし、基準に達しない「おふざけレベル」の動画は生成可能であり、これが問題となる。

- 寿司を舐めて元のレーンに戻す

- コンビニの冷蔵庫に入る

- おでんにイタズラをする(チョコを入れるなど)

一見軽い悪ふざけに見えるが、風評被害や業界全体への不信感を拡大する効果は十分にある。

結論

生成AIによる動画は、一部の有名人や特定の立場の人だけでなく、社会と関わりを持つすべての人が影響を受け得る問題である。

学生、会社員、医療従事者、地域活動家など、日常生活で人と接するすべての人が、標的にされる可能性がある。

SNS時代の拡散力を考えれば、「自分は関係ない」とは言えない。

だからこそ個人も企業も、そして社会全体として、このリスクを現実のものとして認識し、どのように身を守るか、どのように対処するかを、考えることが不可欠である。

動画に対する信頼性の崩壊

動画生成AIの進化によって、本物と偽物の区別がつかなくなる危険性がある。

これまで社会は「映像=確かな証拠」としてきたが、その前提が崩れつつある。

実際に犯罪や迷惑行為が起きても、加害者が「これはAIで作られた偽物だ」と言い逃れをする可能性が高まる。

その結果、信頼の軸は国や大手報道機関など権威ある組織が発信した映像に集中するようになるだろう。

しかし、厳密には人間が関わる以上、国家や報道機関であっても誤りや不祥事(職員・社員の低いリテラシー、外注の業者がやらかす)は避けられず、完全な信頼は保証できない。

問題はこうした状況下では、個人や知名度の低い企業・団体が発信する映像はほとんど信用されなくなる点である。

個人や小規模メディアの情報発信は軽視され、結果的に情報の多様性が失われるリスクがある。

経済的・産業的リスク

動画生成AIは、映像制作・広告・声優・音楽など幅広い業界に少なからず影響を及ぼす。

今すぐにすべての仕事が置き換えられるわけではないが、5年後・10年後には産業構造そのものを揺るがす可能性が高い。

例えば日本の場合、アニメは世界的に高い評価を受けており、重要な文化産業のひとつである。

しかし動画生成AIが普及すれば、日本と同等の水準を持つアニメーションが、世界中の誰でも短時間で作れるようになる。

これにより、日本のアニメ制作の強みであった「高い作画技術」や「独自の映像表現」は、優位性を失う恐れがある。

さらに、作風や演出スタイルは著作権で保護されないため、模倣やコピーに対して法的な防御が難しい。

つまり、日本のアニメーション技術や表現様式は、AIによって容易に再現・拡散され、法律で守られる可能性が低いのである。

国際競争の中で日本のアニメ産業が劣勢に立たされるのは避けられず、結果として映像制作会社、声優、音楽業界が大きな打撃を受ける、もしくは壊滅するかもしれない。

OpenAI側の対応

ただOpenAI側も既に著作権侵害に対する対応を表明している。

サム・アルトマンはブログで以下のように述べている。

Please expect a very high rate of change from us; it reminds me of the early days of ChatGPT. We will make some good decisions and some missteps, but we will take feedback and try to fix the missteps very quickly. We plan to do our iteration on different approaches in Sora, but then apply it consistently across our products.

今後、非常に速いペースで変化していくことをご承知おきください。ChatGPTの初期の頃を思い出します。良い決断をすることもあるでしょうし、失敗もするでしょう。しかし、フィードバックをいただき、失敗は迅速に修正するよう努めます。Soraでは様々なアプローチでイテレーションを行い、それを製品全体に一貫して適用していく予定です。

サービス開始当初では、ピカチュウやマリオといったキャラクターや、日本の政治家を用いた肯定的なものから否定的扇動的または侮蔑的な動画が生成されていた。

それに対する対応を数日で行っているため、しばらくはOpenAIの対応を見守るべきだろう。

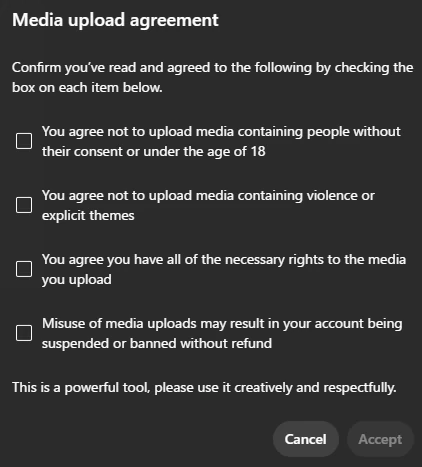

参考までにSora 2の「追加されたメディアアップロードに関する同意」に関する画面を貼っておく

メディアアップロードに関する同意

以下の各項目にチェックを入れることで、以下の内容を読み、同意したことを確認してください。

- 本人の同意を得ず、または18歳未満の人物が映っているメディアをアップロードしないことに同意します。

- 暴力や露骨なテーマを含むメディアをアップロードしないことに同意します。

- アップロードするメディアに関する必要な権利をすべて有することに同意します。

- メディアアップロードを不正に使用した場合、アカウントが停止または禁止され、返金されない場合があります。

これは強力なツールです。創造的に、そして敬意を持ってご利用ください。

Sora 2 Media upload agreementの日本語訳

結論

動画生成AIは、ほぼ無限とも言える創造の可能性を秘めた、非常に強力で魅力的なツールであることは間違いない。

映像表現やエンタメ、教育や研究など、多くの分野に革新をもたらす可能性を持っている。

しかし同時に、リスクを正しく認識し検討することが欠かせない。

生成AIによって作られた偽情報やフェイク動画は、個人の生活・信用・仕事・人間関係を脅かす危険をはらんでいる。

実際に、無実の人が捏造映像で炎上し、社会的に大きなダメージを受ける可能性は現実的に存在する。

また映像に携わる人々は、収入が減ったり職を失う恐れがある。

したがって、動画生成AIを社会に活用していくためには、「便利さと面白さ」だけでなく、「倫理・法制度・教育・リテラシー」という防御策も同時に整える必要がある。

そうして初めて、この強力なツールを安全に享受できるといえる。